Vlastní čísla a vlastní vektory - Eigenvalues and eigenvectors

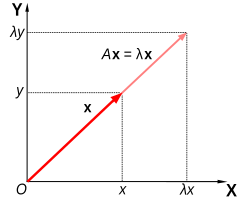

v lineární algebra, an vlastní vektor (/ˈaɪɡənˌprotiɛkt.r/) nebo charakteristický vektor a lineární transformace je nenulová vektor to se mění o skalární faktor, když se na něj použije lineární transformace. Korespondence vlastní číslo, často označované ,[1] je faktor, kterým se vlastní vektor zmenší.

Geometricky, vlastní vektor, odpovídající a nemovitý nenulová vlastní hodnota, ukazuje ve směru, ve kterém je natažené transformací a vlastní hodnota je faktor, kterým se protáhne. Pokud je vlastní hodnota záporná, směr je obrácen.[2] Volně řečeno, ve vícerozměrné podobě vektorový prostor, vlastní vektor se neotáčí.

Formální definice

Li T je lineární transformace z vektorového prostoru PROTI přes pole F do sebe a proti je nenulové vektor v PROTI, pak proti je vlastní vektor T -li T(proti) je skalární násobek proti. To lze zapsat jako

kde λ je skalární F, známý jako vlastní číslo, charakteristická hodnotanebo charakteristický kořen spojený s proti.

Existuje přímá korespondence mezi n-podle-n čtvercové matice a lineární transformace z n-dimenzionální vektorový prostor do sebe, daný základ vektorového prostoru. Proto je v konečně-dimenzionálním vektorovém prostoru ekvivalentní definovat vlastní čísla a vlastní vektory pomocí jazyka jazyka matice nebo jazyk lineárních transformací.[3][4]

Li PROTI je konečný rozměr, výše uvedená rovnice je ekvivalentní[5]

kde A je maticová reprezentace T a u je vektor souřadnic proti.

Přehled

Vlastní čísla a vlastní vektory jsou prominentní v analýze lineárních transformací. Předpona vlastní je převzato z Němec slovo vlastní (příbuzný s Angličtina slovo vlastní ) pro „správné“, „charakteristické“, „vlastní“.[6][7] Původně se používalo ke studiu hlavní osy rotačního pohybu tuhá tělesa vlastní čísla a vlastní vektory mají širokou škálu aplikací, například v analýza stability, vibrační analýza, atomové orbitaly, Rozpoznávání obličeje, a maticová diagonalizace.

V podstatě vlastní vektor proti lineární transformace T je nenulový vektor, který, když T je použito, nemění směr. Přihlašování T do vlastního vektoru změní pouze vlastní vektor podle skalární hodnoty λ, nazývané vlastní číslo. Tuto podmínku lze zapsat jako rovnici

označované jako rovnice vlastního čísla nebo vlastní rovnice. Obecně, λ může být jakýkoli skalární. Například, λ může být záporný, v takovém případě vlastní vektor obrací směr jako součást změny měřítka, nebo může být nulový nebo komplex.

The Mona Lisa zde uvedený příklad poskytuje jednoduchou ilustraci. Každý bod na malbě lze reprezentovat jako vektor směřující od středu malby k tomuto bodu. Lineární transformace se v tomto příkladu nazývá a smykové mapování. Body v horní polovině se posunou doprava a body ve spodní polovině se posunou doleva, úměrně tomu, jak daleko jsou od vodorovné osy, která prochází středem obrazu. Vektory ukazující na každý bod v původním obrázku jsou proto nakloněny doprava nebo doleva a transformací jsou zvětšeny nebo zmenšeny. Body podél horizontální osa se při použití této transformace vůbec nepohybuje. Každý vektor, který směřuje přímo doprava nebo doleva bez svislé komponenty, je tedy vlastním vektorem této transformace, protože mapování nezmění svůj směr. Navíc všechny tyto vlastní vektory mají vlastní hodnotu rovnou jedné, protože mapování také nemění jejich délku.

Lineární transformace mohou mít mnoho různých forem, mapování vektorů v různých vektorových prostorech, takže vlastní vektory mohou mít také mnoho podob. Například lineární transformace může být a operátor diferenciálu jako , v tom případě jsou vlastní vektory nazývány funkcí vlastní funkce které jsou škálovány tímto diferenciálním operátorem, například

Alternativně může mít lineární transformace podobu n podle n matice, v tom případě jsou vlastní vektory n o 1 matici. Pokud je lineární transformace vyjádřena ve formě n podle n matice A, potom lze rovnici vlastních čísel pro lineární transformaci výše přepsat jako násobení matice

kde vlastní vektor proti je n o 1 matici. Pro matici lze použít vlastní čísla a vlastní vektory rozložit matici — Například od úhlopříčka to.

Vlastní čísla a vlastní vektory dávají vzniknout mnoha úzce souvisejícím matematickým konceptům a předponě vlastní se při jejich pojmenování používá liberálně:

- Sada všech vlastních vektorů lineární transformace, každá spárovaná s odpovídající vlastní hodnotou, se nazývá vlastní systém této transformace.[8][9]

- Sada všech vlastních vektorů T odpovídající stejné vlastní hodnotě, společně s nulovým vektorem, se nazývá an vlastní prostor, nebo charakteristický prostor z T spojené s touto vlastní hodnotou.[10]

- Pokud je sada vlastních vektorů T tvoří a základ domény T, pak se tento základ nazývá vlastní základna.

Dějiny

Vlastní čísla se často zavádějí v kontextu lineární algebra nebo teorie matic. Historicky však vznikly při studiu kvadratické formy a diferenciální rovnice.

V 18. století Leonhard Euler studoval rotační pohyb a tuhé tělo, a objevil význam hlavní osy.[A] Joseph-Louis Lagrange si uvědomil, že hlavní osy jsou vlastní vektory setrvačné matice.[11]

Na počátku 19. století Augustin-Louis Cauchy viděl, jak lze jejich práci použít ke klasifikaci kvadrické povrchy, a zobecnil to na libovolné rozměry.[12] Cauchy také vytvořil termín racine caractéristique (charakteristický kořen), pro to, co se nyní nazývá vlastní číslo; jeho funkční období přežije v charakteristická rovnice.[b]

Později, Joseph Fourier použil práci Lagrangeových a Pierre-Simon Laplace vyřešit rovnice tepla podle oddělení proměnných ve své slavné knize z roku 1822 Théorie analytique de la chaleur.[13] Charles-François Sturm dále rozvinul Fourierovy myšlenky a upozornil je na Cauchyho, který je spojil se svými vlastními myšlenkami a dospěl k tomu, že skutečné symetrické matice mají skutečná vlastní čísla.[12] Toto bylo rozšířeno o Charles Hermite v roce 1855 k tomu, co se nyní nazývá Hermitovské matice.[14]

Přibližně ve stejnou dobu Francesco Brioschi dokázal, že vlastní hodnoty ortogonální matice ležet na jednotkový kruh,[12] a Alfred Clebsch našel odpovídající výsledek pro zkosené symetrické matice.[14] Konečně, Karl Weierstrass vyjasnil důležitý aspekt v EU teorie stability začal Laplace tím, že si to uvědomil vadné matice může způsobit nestabilitu.[12]

Mezitím, Joseph Liouville studoval problémy s vlastními čísly podobné problémům se Sturmem; disciplína, která vyrostla z jejich práce, se nyní nazývá Teorie Sturm – Liouville.[15] Schwarz prostudoval první vlastní hodnotu Laplaceova rovnice o obecných doménách na konci 19. století, zatímco Poincaré studoval Poissonova rovnice o pár let později.[16]

Na začátku 20. století David Hilbert studoval vlastní čísla integrální operátory prohlížením operátorů jako nekonečných matic.[17] Byl první, kdo použil Němec slovo vlastní, což znamená „vlastní“,[7] k označení vlastních čísel a vlastních vektorů v roce 1904,[C] i když možná sledoval související použití od Hermann von Helmholtz. Po nějakou dobu byl standardní termín v angličtině „správná hodnota“, ale výraznější výraz „eigenvalue“ je dnes standardem.[18]

První numerický algoritmus pro výpočet vlastních čísel a vlastních vektorů se objevil v roce 1929, kdy Richard von Mises zveřejnil metoda napájení. Jedna z nejpopulárnějších metod současnosti, Algoritmus QR, navrhl nezávisle John G. F. Francis[19] a Věra Kublanovská[20] v roce 1961.[21][22]

Vlastní čísla a vlastní vektory matic

Vlastní čísla a vlastní vektory jsou studentům často představovány v rámci kurzů lineární algebry zaměřených na matice.[23][24]Kromě toho lze lineární transformace přes konečný trojrozměrný vektorový prostor reprezentovat pomocí matic,[25][4] což je obzvláště běžné v numerických a výpočetních aplikacích.[26]

Zvážit n-dimenzionální vektory, které jsou vytvořeny jako seznam n skaláry, jako jsou trojrozměrné vektory

O těchto vektorech se říká, že jsou skalární násobky navzájem, nebo paralelní nebo kolineární, pokud existuje skalár λ takhle

V tomto případě .

Nyní zvažte lineární transformaci n-dimenzionální vektory definované pomocí n podle n matice A,

nebo

kde pro každý řádek

- .

Pokud k tomu dojde proti a w jsou skalární násobky, tedy pokud

(1)

pak proti je vlastní vektor lineární transformace A a měřítkový faktor λ je vlastní číslo odpovídající tomuto vlastnímu vektoru. Rovnice (1) je rovnice vlastního čísla pro matici A.

Rovnice (1) lze uvést rovnocenně jako

(2)

kde Já je n podle n matice identity a 0 je nulový vektor.

Vlastní čísla a charakteristický polynom

Rovnice (2) má nenulové řešení proti kdyby a jen kdyby the určující matice (A − λI) je nula. Proto vlastní čísla z A jsou hodnoty λ které splňují rovnici

(3)

Použitím Leibnizovo pravidlo pro determinant, levá strana rovnice (3) je polynomiální funkce proměnné λ a stupeň tohoto polynomu je n, pořadí matice A. Své koeficienty závisí na položkách A, kromě toho, že jeho termín stupně n je vždy (-1)nλn. Tento polynom se nazývá charakteristický polynom z A. Rovnice (3) se nazývá charakteristická rovnice nebo sekulární rovnice z A.

The základní věta o algebře znamená, že charakteristický polynom an n-podle-n matice A, což je polynom stupně n, může být započteno do produktu n lineární výrazy,

(4)

kde každý λi může být skutečné, ale obecně je to komplexní číslo. Čísla λ1, λ2, ... λn, které nemusí mít všechny odlišné hodnoty, jsou kořeny polynomu a jsou vlastními čísly A.

Jako krátký příklad, který je podrobněji popsán v části s příklady níže, zvažte matici

Vezmeme-li determinant (A − λI), charakteristický polynom z A je

Nastavením charakteristického polynomu na nulu má kořeny v λ = 1 a λ = 3, což jsou dvě vlastní čísla A. Vlastní vektory odpovídající každému vlastnímu číslu lze najít řešením pro komponenty proti v rovnici . V tomto příkladu jsou vlastní vektory jakékoli nenulové skalární násobky

Pokud jsou záznamy matice A jsou všechna reálná čísla, pak koeficienty charakteristického polynomu budou také reálná čísla, ale vlastní čísla mohou stále mít nenulové imaginární části. Záznamy příslušných vlastních vektorů proto mohou mít také nenulové imaginární části. Podobně mohou být vlastní čísla iracionální čísla i když všechny položky z A jsou racionální čísla nebo i když jsou všechna celá čísla. Pokud však položky z A všichni jsou algebraická čísla, která zahrnují racionály, vlastní čísla jsou komplexní algebraická čísla.

Nereálné kořeny skutečného polynomu se skutečnými koeficienty lze seskupit do dvojic komplexní konjugáty, jmenovitě s tím, že dva členové každé dvojice mají imaginární části, které se liší pouze znaménkem a stejnou skutečnou částí. Pokud je stupeň lichý, pak podle věta o střední hodnotě alespoň jeden z kořenů je skutečný. Proto jakýkoli skutečná matice s lichým řádem má alespoň jedno skutečné vlastní číslo, zatímco skutečná matice se sudým řádem nemusí mít žádná skutečná vlastní čísla. Vlastní vektory spojené s těmito komplexními vlastními čísly jsou také složité a objevují se také ve složitých konjugovaných párech.

Algebraická multiplicita

Nechat λi být vlastním číslem n podle n matice A. The algebraická multiplicita μA(λi) vlastního čísla je jeho multiplicita jako kořen charakteristického polynomu, tj. největšího celého čísla k takový, že (λ − λi)k rozděluje rovnoměrně ten polynom.[10][27][28]

Předpokládejme matici A má rozměr n a d ≤ n odlišné vlastní hodnoty. Vzhledem k tomu, že rovnice (4) určuje charakteristický polynom A do produktu n lineární termíny, přičemž některé termíny se mohou opakovat, lze charakteristický polynom namísto toho zapsat jako produkt d výrazy, které každý odpovídá zřetelné vlastní hodnotě a jsou zvýšeny na moc algebraické multiplicity,

Li d = n pak je pravá strana produktem n lineární termíny a to je stejné jako rovnice (4). Velikost algebraické multiplicity každého vlastního čísla souvisí s dimenzí n tak jako

Li μA(λi) = 1, tedy λi se říká, že je jednoduchá vlastní hodnota.[28] Li μA(λi) se rovná geometrické multiplicitě λi, yA(λi), definovaný v další části λi se říká, že je polojednoduché vlastní číslo.

Vlastní prostory, geometrická multiplicita a vlastní základy pro matice

Vzhledem k určité vlastní hodnotě λ z n podle n matice A, definovat soubor E být všechny vektory proti které splňují rovnici (2),

Na jedné straně je tato sada přesně jádro nebo prázdný prostor matice (A − λI). Na druhou stranu, podle definice, jakýkoli nenulový vektor, který splňuje tuto podmínku, je vlastním vektorem A spojený s λ. Takže sada E je svaz nulového vektoru se sadou všech vlastních vektorů A spojený s λ, a E se rovná prázdnému prostoru (A − λI). E se nazývá vlastní prostor nebo charakteristický prostor z A spojený s λ.[29][10] Obecně λ je komplexní číslo a vlastní vektory jsou komplexní n o 1 matici. Vlastností prázdného prostoru je, že je to lineární podprostor, tak E je lineární podprostor ℂn.

Protože vlastní prostor E je lineární podprostor, to je Zavřeno pod přidáním. To znamená, že pokud dva vektory u a proti patří do sady E, psaný u, proti ∈ E, pak (u + proti) ∈ E nebo ekvivalentně A(u + proti) = λ(u + proti). To lze zkontrolovat pomocí distribuční vlastnictví násobení matic. Podobně proto E je lineární podprostor, je uzavřen pod skalárním násobením. To je, pokud proti ∈ E a α je komplexní číslo, (αv) ∈ E nebo ekvivalentně A(αproti) = λ(αv). To lze zkontrolovat poznamenáním, že násobení komplexních matic komplexními čísly je komutativní. Tak dlouho jak u + proti a αv nejsou nula, jsou také vlastními vektory A spojený s λ.

Dimenze vlastního prostoru E spojený s λnebo ekvivalentně maximální počet lineárně nezávislých vlastních vektorů spojených s λ, se označuje jako vlastní číslo geometrická multiplicita yA(λ). Protože E je také prázdný prostor (A − λI), geometrická multiplicita λ je rozměr prázdného prostoru (A − λI), také nazývaný neplatnost z (A − λI), který souvisí s dimenzí a hodností (A − λI) tak jako

Z důvodu definice vlastních čísel a vlastních vektorů musí být geometrická multiplicita vlastních čísel alespoň jedna, to znamená, že každá vlastní hodnota má alespoň jeden přidružený vlastní vektor. Geometrická multiplicita vlastního čísla dále nemůže překročit její algebraickou multiplicitu. Dále si pamatujte, že algebraická multiplicita vlastního čísla nemůže překročit n.

Dokázat nerovnost , zvažte, jak definice geometrické multiplicity znamená existenci ortonormální vlastní vektory , takový, že . Můžeme tedy najít (jednotnou) matici jehož první sloupce jsou tyto vlastní vektory a jejichž zbývajícími sloupci může být jakákoli ortonormální sada vektory kolmé k těmto vlastním vektorům . Pak má úplnou hodnost, a proto je invertibilní, a s matice, jejíž horní levý blok je diagonální matice . To z toho vyplývá . Jinými slovy, je podobný , což z toho vyplývá . Ale z definice víme, že obsahuje faktor , což znamená, že algebraická multiplicita musí uspokojit .

Předpokládat má odlišné vlastní hodnoty , kde geometrická multiplicita je . Celková geometrická multiplicita ,

je rozměr součet všech vlastních prostorů vlastních čísel nebo ekvivalentně maximální počet lineárně nezávislých vlastních vektorů . Li , pak

- Přímý součet vlastních prostorů všech Vlastní čísla jsou celý vektorový prostor .

- Základem lze vytvořit z lineárně nezávislé vlastní vektory ; takový základ se nazývá vlastní základna

- Libovolný vektor v lze psát jako lineární kombinaci vlastních vektorů .

Další vlastnosti vlastních čísel

Nechat být libovolný matice komplexních čísel s vlastními hodnotami . Zobrazí se každé vlastní číslo krát v tomto seznamu, kde je algebraická multiplicita vlastního čísla. Vlastnosti této matice a jejích vlastních čísel jsou následující:

- The stopa z , definovaný jako součet jeho diagonálních prvků, je také součtem všech vlastních čísel,

- The určující z je produktem všech vlastních čísel,

- Vlastní čísla th síla ; tj. vlastní čísla , pro jakékoli kladné celé číslo , jsou .

- Matice je invertibilní právě když je každé vlastní číslo nenulové.

- Li je invertibilní, pak vlastní čísla z jsou a geometrická multiplicita každého vlastního čísla se shoduje. Navíc, protože charakteristický polynom inverzní je reciproční polynom originálu vlastní čísla sdílejí stejnou algebraickou multiplicitu.

- Li se rovná jeho konjugovat transponovat , nebo ekvivalentně, pokud je Hermitian, pak je každé vlastní číslo skutečné. Totéž platí pro všechny symetrický skutečná matice.

- Li je nejen Hermitian, ale také pozitivní-definitivní, pozitivní-semidefinitní, negativní-definitivní nebo negativní-semidefinitní, pak každé vlastní číslo je pozitivní, nezáporné, negativní nebo nepříznivé.

- Li je unitární, každé vlastní číslo má absolutní hodnotu .

- -li je matice a jsou jeho vlastní čísla, pak vlastní čísla matice (kde je matice identity) jsou . Navíc pokud , vlastní čísla jsou . Obecněji pro polynom vlastní čísla matice jsou .

Levý a pravý vlastní vektor

Mnoho oborů tradičně představuje vektory jako matice s jedním sloupcem, spíše než jako matice s jedním řádkem. Z tohoto důvodu slovo „vlastní vektor“ v kontextu matic téměř vždy odkazuje na a pravý vlastní vektor, jmenovitě a sloupec vektor, který že jo znásobuje matice v definující rovnici, Rovnice (1),

Problém vlastních čísel a vlastních vektorů lze také definovat pro řádek vektory, které vlevo, odjet násobit matici . V této formulaci je určující rovnice

kde je skalární a je matice. Libovolný vektor řádku splnění této rovnice se nazývá a levý vlastní vektor z a je jeho přidružené vlastní číslo. Vezmeme-li v úvahu tuto rovnici,

Porovnáním této rovnice s rovnicí (1), okamžitě vyplývá, že levý vlastní vektor je stejná jako transpozice pravého vlastního vektoru z , se stejnou vlastní hodnotou. Kromě toho, protože charakteristický polynom z je stejný jako charakteristický polynom z , vlastní čísla levých vlastních vektorů jsou stejná jako vlastní čísla pravých vlastních vektorů .

Diagonalizace a vlastní složení

Předpokládejme vlastní vektory A tvoří základ nebo ekvivalentně A má n lineárně nezávislé vlastní vektory proti1, proti2, ..., protin s přidruženými vlastními hodnotami λ1, λ2, ..., λn. Vlastní čísla nemusí být odlišná. Definujte čtvercovou matici Q jejichž sloupce jsou n lineárně nezávislé vlastní vektory A,

Od každého sloupce Q je vlastní vektor A, pravé násobení A podle Q změní měřítko každého sloupce Q přidruženým vlastním číslem,

S ohledem na to definujte diagonální matici Λ, kde je každý diagonální prvek Λii je vlastní číslo spojené s ith sloupec Q. Pak

Protože sloupce Q jsou lineárně nezávislé, Q je invertibilní. Vpravo vynásobte obě strany rovnice Q−1,

nebo tím, že místo toho levé strany vynásobíte oběma stranami Q−1,

A lze proto rozložit na matici složenou z jejích vlastních vektorů, diagonální matici se svými vlastními hodnotami podél úhlopříčky a inverzní matici vlastních vektorů. Tomu se říká vlastní složení a je to transformace podobnosti. Taková matice A se říká, že je podobný na diagonální matici Λ nebo úhlopříčně. Matice Q je změna základní matice transformace podobnosti. V podstatě matice A a Λ představují stejnou lineární transformaci vyjádřenou ve dvou různých bázích. Vlastní vektory se používají jako základ při reprezentaci lineární transformace jako Λ.

Naopak předpokládejme matici A je diagonalizovatelný. Nechat P být ne-singulární čtvercová matice taková P−1AP je nějaká diagonální matice D. Vlevo vynásobením obou P, AP = PD. Každý sloupec P proto musí být vlastním vektorem A jehož vlastní hodnota je odpovídajícím diagonálním prvkem D. Vzhledem k tomu, že sloupce P musí být lineárně nezávislé pro P být invertibilní, existují n lineárně nezávislé vlastní vektory A. Z toho vyplývá, že vlastní vektory A tvoří základ právě tehdy A je diagonalizovatelný.

Říká se, že matice, která není diagonalizovatelná vadný. U vadných matic se pojem vlastních vektorů zobecňuje na zobecněné vlastní vektory a diagonální matice vlastních čísel se zobecňuje na Jordan normální forma. Přes algebraicky uzavřené pole, libovolná matice A má Jordan normální forma a proto připouští základ zobecněných vlastních vektorů a rozklad na zobecněné vlastní prostory.

Variační charakterizace

V Hermitian v případě, vlastním číslům může být dána variační charakterizace. Největší vlastní hodnota je maximální hodnota kvadratická forma . Hodnota který si toto maximum uvědomuje, je vlastní vektor.

Maticové příklady

Příklad dvourozměrné matice

Zvažte matici

Obrázek vpravo ukazuje účinek této transformace na bodové souřadnice v rovině. Vlastní vektory proti této transformace uspokojit rovnici (1) a hodnoty λ pro které je determinant matice (A − λI) rovná se nula jsou vlastní čísla.

Vezmeme determinant k nalezení charakteristického polynomu A,

Nastavením charakteristického polynomu na nulu má kořeny v λ=1 a λ=3, což jsou dvě vlastní čísla A.

Pro λ=1, Rovnice (2) se stává,

- ;

Libovolný nenulový vektor s proti1 = −proti2 řeší tuto rovnici. Proto,

je vlastní vektor A souhlasí s λ = 1, stejně jako jakýkoli skalární násobek tohoto vektoru.

Pro λ=3, Rovnice (2) se stává

- ;

Libovolný nenulový vektor s proti1 = proti2 řeší tuto rovnici. Proto,

je vlastní vektor A souhlasí s λ = 3, stejně jako jakýkoli skalární násobek tohoto vektoru.

Tedy vektory protiλ=1 a protiλ=3 jsou vlastní vektory A spojené s vlastními hodnotami λ=1 a λ=3, resp.

Příklad trojrozměrné matice

Zvažte matici

Charakteristický polynom z A je

Kořeny charakteristického polynomu jsou 2, 1 a 11, což jsou jediné tři vlastní hodnoty A. Tyto vlastní hodnoty odpovídají vlastním vektorům a nebo jakýkoli jejich nenulový násobek.

Příklad trojrozměrné matice se složitými vlastními hodnotami

Zvažte cyklická permutační matice

Tato matice posune souřadnice vektoru nahoru o jednu pozici a posune první souřadnici dolů. Jeho charakteristický polynom je 1 -λ3, jehož kořeny jsou

kde je imaginární jednotka s

Pro skutečné vlastní číslo λ1 = 1, libovolný vektor se třemi stejnými nenulovými položkami je vlastní vektor. Například,

Pro komplexní konjugovanou dvojici imaginárních vlastních čísel,

Pak

a

Proto další dva vlastní vektory A jsou složité a jsou a s vlastními hodnotami λ2 a λ3, resp. Dva komplexní vlastní vektory se také objevují ve složitém dvojici konjugátů,

Příklad diagonální matice

Matice se vstupy pouze podél hlavní úhlopříčky jsou volány diagonální matice. Vlastní čísla diagonální matice jsou samotné diagonální prvky. Zvažte matici

Charakteristický polynom z A je

který má kořeny λ1=1, λ2=2, a λ3=3. Tyto kořeny jsou diagonální prvky i vlastní číslaA.

Každý diagonální prvek odpovídá vlastnímu vektoru, jehož jediná nenulová složka je ve stejném řádku jako tento diagonální prvek. V tomto příkladu vlastní čísla odpovídají vlastním vektorům,

respektive skalární násobky těchto vektorů.

Příklad trojúhelníkové matice

Matice, jejíž prvky nad hlavní úhlopříčkou jsou všechny nulové, se nazývá a dolní trojúhelníková matice, zatímco matice, jejíž prvky pod hlavní úhlopříčkou jsou všechny nulové, se nazývá an horní trojúhelníková matice. Stejně jako u diagonálních matic jsou vlastní hodnoty trojúhelníkových matic prvky hlavní úhlopříčky.

Zvažte spodní trojúhelníkovou matici,

Charakteristický polynom z A je

který má kořeny λ1=1, λ2=2, a λ3=3. Tyto kořeny jsou diagonální prvky i vlastní číslaA.

Tyto vlastní hodnoty odpovídají vlastním vektorům,

respektive skalární násobky těchto vektorů.

Matice s příkladem opakovaných vlastních čísel

Stejně jako v předchozím příkladu, spodní trojúhelníková matice

má charakteristický polynom, který je produktem jeho diagonálních prvků,

Kořeny tohoto polynomu, a tedy vlastní čísla, jsou 2 a 3. The algebraická multiplicita každého vlastního čísla je 2; jinými slovy jsou oba dvojité kořeny. Součet algebraických multiplicit všech odlišných vlastních čísel je μA = 4 = n, pořadí charakteristického polynomu a rozměr A.

Na druhou stranu geometrická multiplicita vlastní hodnoty 2 je pouze 1, protože jeho vlastní prostor je překlenut pouze jedním vektorem a je tedy jednorozměrný. Podobně geometrická multiplicita vlastní hodnoty 3 je 1, protože její vlastní prostor je překlenut pouze jedním vektorem . Celková geometrická multiplicita yA je 2, což je nejmenší, jaký by mohl být pro matici se dvěma odlišnými vlastními hodnotami. Geometrické multiplicity jsou definovány v pozdější části.

Vlastní hodnota - identita vlastního čísla

Pro Hermitova matice, norma na druhou z jth složka normalizovaného vlastního vektoru lze vypočítat pouze s použitím vlastních čísel matice a vlastních čísel odpovídajících vedlejší matice,

Vlastní čísla a vlastní funkce diferenciálních operátorů

Definice vlastních čísel a vlastních vektorů lineární transformace T remains valid even if the underlying vector space is an infinite-dimensional Hilbert nebo Banachův prostor. A widely used class of linear transformations acting on infinite-dimensional spaces are the diferenciální operátory na funkční prostory. Nechat D be a linear differential operator on the space C∞ of infinitely rozlišitelný real functions of a real argument t. The eigenvalue equation for D je diferenciální rovnice

The functions that satisfy this equation are eigenvectors of D and are commonly called eigenfunctions.

Derivative operator example

Consider the derivative operator with eigenvalue equation

This differential equation can be solved by multiplying both sides by dt/F(t) and integrating. Its solution, the exponenciální funkce

is the eigenfunction of the derivative operator. In this case the eigenfunction is itself a function of its associated eigenvalue. Zejména pro λ = 0 the eigenfunction F(t) je konstanta.

Hlavní vlastní funkce article gives other examples.

Obecná definice

The concept of eigenvalues and eigenvectors extends naturally to arbitrary lineární transformace on arbitrary vector spaces. Nechat PROTI be any vector space over some pole K. z skaláry, and let T be a linear transformation mapping PROTI do PROTI,

We say that a nonzero vector proti ∈ PROTI je vlastní vektor z T if and only if there exists a scalar λ ∈ K. takhle

(5)

This equation is called the eigenvalue equation for T, and the scalar λ je vlastní číslo z T corresponding to the eigenvector proti. T(proti) is the result of applying the transformation T to the vector proti, zatímco λproti is the product of the scalar λ s proti.[38][39]

Eigenspaces, geometric multiplicity, and the eigenbasis

Given an eigenvalue λ, consider the set

which is the union of the zero vector with the set of all eigenvectors associated with λ. E se nazývá vlastní prostor nebo characteristic space z T spojený sλ.

By definition of a linear transformation,

pro (X,y) ∈ PROTI and α ∈ K.. Proto pokud u a proti are eigenvectors of T associated with eigenvalue λ, jmenovitě u,proti ∈ E, pak

So, both u + proti a αproti are either zero or eigenvectors of T spojený s λ, jmenovitě u + proti, αproti ∈ E, a E is closed under addition and scalar multiplication. The eigenspace E spojený s λ is therefore a linear subspace of PROTI.[40]If that subspace has dimension 1, it is sometimes called an eigenline.[41]

The geometrická multiplicita yT(λ) of an eigenvalue λ is the dimension of the eigenspace associated with λ, i.e., the maximum number of linearly independent eigenvectors associated with that eigenvalue.[10][28] By the definition of eigenvalues and eigenvectors, yT(λ) ≥ 1 because every eigenvalue has at least one eigenvector.

The eigenspaces of T always form a přímý součet. As a consequence, eigenvectors of odlišný eigenvalues are always linearly independent. Therefore, the sum of the dimensions of the eigenspaces cannot exceed the dimension n of the vector space on which T operates, and there cannot be more than n distinct eigenvalues.[d]

Any subspace spanned by eigenvectors of T je invariantní podprostor z T, and the restriction of T to such a subspace is diagonalizable. Moreover, if the entire vector space PROTI can be spanned by the eigenvectors of T, or equivalently if the direct sum of the eigenspaces associated with all the eigenvalues of T is the entire vector space PROTI, then a basis of PROTI volal eigenbasis can be formed from linearly independent eigenvectors of T. Když T admits an eigenbasis, T is diagonalizable.

Zero vector as an eigenvector

While the definition of an eigenvector used in this article excludes the nulový vektor, it is possible to define eigenvalues and eigenvectors such that the zero vector is an eigenvector.[42]

Consider again the eigenvalue equation, Equation (5). Define an vlastní číslo to be any scalar λ ∈ K. such that there exists a nonzero vector proti ∈ PROTI satisfying Equation (5). It is important that this version of the definition of an eigenvalue specify that the vector be nonzero, otherwise by this definition the zero vector would allow any scalar in K. to be an eigenvalue. Define an vlastní vektor proti associated with the eigenvalue λ to be any vector that, given λ, satisfies Equation (5). Given the eigenvalue, the zero vector is among the vectors that satisfy Equation (5), so the zero vector is included among the eigenvectors by this alternate definition.

Spektrální teorie

Li λ je vlastní číslo z T, then the operator (T − λI) is not one-to-one, and therefore its inverse (T − λI)−1 neexistuje. The converse is true for finite-dimensional vector spaces, but not for infinite-dimensional vector spaces. In general, the operator (T − λI) may not have an inverse even if λ is not an eigenvalue.

For this reason, in funkční analýza eigenvalues can be generalized to the spectrum of a linear operator T as the set of all scalars λ for which the operator (T − λI) has no ohraničený inverse. The spectrum of an operator always contains all its eigenvalues but is not limited to them.

Associative algebras and representation theory

One can generalize the algebraic object that is acting on the vector space, replacing a single operator acting on a vector space with an reprezentace algebry – an associative algebra acting on a modul. The study of such actions is the field of teorie reprezentace.

The representation-theoretical concept of weight is an analog of eigenvalues, while weight vectors a weight spaces are the analogs of eigenvectors and eigenspaces, respectively.

Dynamické rovnice

Nejjednodušší rozdílové rovnice mít formu

Řešení této rovnice pro X ve smyslu t is found by using its characteristic equation

which can be found by stacking into matrix form a set of equations consisting of the above difference equation and the k – 1 equations giving a k-dimensional system of the first order in the stacked variable vector in terms of its once-lagged value, and taking the characteristic equation of this system's matrix. This equation gives k characteristic roots for use in the solution equation

A similar procedure is used for solving a diferenciální rovnice formuláře

Výpočet

The calculation of eigenvalues and eigenvectors is a topic where theory, as presented in elementary linear algebra textbooks, is often very far from practice.

Classical method

The classical method is to first find the eigenvalues, and then calculate the eigenvectors for each eigenvalue. It is in several ways poorly suited for non-exact arithmetics such as floating-point.

Vlastní čísla

The eigenvalues of a matrix can be determined by finding the roots of the characteristic polynomial. This is easy for matrices, but the difficulty increases rapidly with the size of the matrix.

In theory, the coefficients of the characteristic polynomial can be computed exactly, since they are sums of products of matrix elements; and there are algorithms that can find all the roots of a polynomial of arbitrary degree to any required přesnost.[43] However, this approach is not viable in practice because the coefficients would be contaminated by unavoidable chyby zaokrouhlování, and the roots of a polynomial can be an extremely sensitive function of the coefficients (as exemplified by Wilkinson's polynomial ).[43] Even for matrices whose elements are integers the calculation becomes nontrivial, because the sums are very long; the constant term is the určující, which for an is a sum of different products.[E]

Výslovný algebraic formulas for the roots of a polynomial exist only if the degree is 4 or less. Podle Abel – Ruffiniho věta there is no general, explicit and exact algebraic formula for the roots of a polynomial with degree 5 or more. (Generality matters because any polynomial with degree is the characteristic polynomial of some doprovodná matice řádu .) Therefore, for matrices of order 5 or more, the eigenvalues and eigenvectors cannot be obtained by an explicit algebraic formula, and must therefore be computed by approximate numerické metody. Dokonce exact formula for the roots of a degree 3 polynomial is numerically impractical.

Vlastní vektory

Once the (exact) value of an eigenvalue is known, the corresponding eigenvectors can be found by finding nonzero solutions of the eigenvalue equation, that becomes a soustava lineárních rovnic with known coefficients. For example, once it is known that 6 is an eigenvalue of the matrix

we can find its eigenvectors by solving the equation , to je

This matrix equation is equivalent to two linear equations

- to je

Both equations reduce to the single linear equation . Therefore, any vector of the form , for any nonzero real number , is an eigenvector of with eigenvalue .

Matice above has another eigenvalue . A similar calculation shows that the corresponding eigenvectors are the nonzero solutions of , that is, any vector of the form , for any nonzero real number .

Simple iterative methods

The converse approach, of first seeking the eigenvectors and then determining each eigenvalue from its eigenvector, turns out to be far more tractable for computers. The easiest algorithm here consists of picking an arbitrary starting vector and then repeatedly multiplying it with the matrix (optionally normalising the vector to keep its elements of reasonable size); this makes the vector converge towards an eigenvector. A variation is to instead multiply the vector by ; this causes it to converge to an eigenvector of the eigenvalue closest to .

Li is (a good approximation of) an eigenvector of , then the corresponding eigenvalue can be computed as

kde označuje konjugovat transponovat z .

Modern methods

Efficient, accurate methods to compute eigenvalues and eigenvectors of arbitrary matrices were not known until the QR algorithm was designed in 1961.[43] Kombinace Transformace domácnosti with the LU decomposition results in an algorithm with better convergence than the QR algorithm.[Citace je zapotřebí ] Pro velké Hermitian řídké matice, Lanczosův algoritmus is one example of an efficient iterační metoda to compute eigenvalues and eigenvectors, among several other possibilities.[43]

Most numeric methods that compute the eigenvalues of a matrix also determine a set of corresponding eigenvectors as a by-product of the computation, although sometimes implementors choose to discard the eigenvector information as soon as it is no longer needed.

Aplikace

Eigenvalues of geometric transformations

The following table presents some example transformations in the plane along with their 2×2 matrices, eigenvalues, and eigenvectors.

| Škálování | Unequal scaling | Otáčení | Horizontal shear | Hyperbolic rotation | |

|---|---|---|---|---|---|

| Ilustrace |  |  |  |  |  |

| Matice | |||||

| Charakteristický polynomiální | |||||

| Eigenvalues, | , | ||||

| Algebraický mult., | |||||

| Geometrický mult., | |||||

| Vlastní vektory | All nonzero vectors |

The characteristic equation for a rotation is a kvadratická rovnice s diskriminující , which is a negative number whenever θ is not an integer multiple of 180°. Therefore, except for these special cases, the two eigenvalues are complex numbers, ; and all eigenvectors have non-real entries. Indeed, except for those special cases, a rotation changes the direction of every nonzero vector in the plane.

A linear transformation that takes a square to a rectangle of the same area (a zmáčknout mapování ) has reciprocal eigenvalues.

Schrödinger equation

An example of an eigenvalue equation where the transformation is represented in terms of a differential operator is the time-independent Schrödinger equation v kvantová mechanika:

kde , Hamiltonian, je druhého řádu operátor diferenciálu a , vlnová funkce, je jednou z jeho vlastních funkcí odpovídajících vlastnímu číslu , interpretován jako jeho energie.

V případě, že je však zájem pouze o vázaný stav řešení Schrödingerovy rovnice, člověk hledá v prostoru čtvercový integrovatelný funkce. Protože tento prostor je a Hilbertův prostor s dobře definovaným skalární součin, lze zavést a základní sada ve kterém a lze reprezentovat jako jednorozměrné pole (tj. vektor) a matici. To umožňuje reprezentovat Schrödingerovu rovnici ve formě matice.

The braketová notace se v této souvislosti často používá. Vektor, který představuje stav systému, v Hilbertově prostoru čtvercových integrovatelných funkcí je reprezentován . V této notaci je Schrödingerova rovnice:

kde je vlastní stát z a představuje vlastní číslo. je pozorovatelný vlastní adjoint operátor, nekonečně dimenzionální analog hermitovských matic. Stejně jako v případě matice, ve výše uvedené rovnici Termínem "vektor" se rozumí vektor získaný aplikací transformace na .

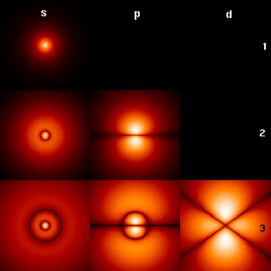

Molekulární orbitaly

v kvantová mechanika, a zejména v atomový a molekulární fyzika, v rámci Hartree – Fock teorie atomový a molekulární orbitaly lze definovat vlastními vektory z Fock operátor. Odpovídající vlastní čísla jsou interpretována jako ionizační potenciály přes Koopmanova věta. V tomto případě se termín vlastní vektor používá v poněkud obecnějším smyslu, protože operátor Fock je výslovně závislý na orbitálech a jejich vlastních hodnotách. Pokud tedy chceme tento aspekt zdůraznit, hovoří se o problémech nelineárních vlastních čísel. Takové rovnice jsou obvykle řešeny pomocí opakování postup, který se v tomto případě nazývá samo-konzistentní pole metoda. v kvantová chemie, jeden často představuje Hartree-Fockovu rovnici vortogonální základní sada. Toto konkrétní znázornění je a zobecněný problém vlastních čísel volala Roothaanovy rovnice.

Geologie a glaciologie

v geologie, zejména při studiu ledová do Vlastní vektory a vlastní hodnoty se používají jako metoda, pomocí které lze v trojrozměrném prostoru shrnout množství informací o orientaci a ponoření složek klastové látky do šesti čísel. V terénu může geolog shromažďovat taková data pro stovky nebo tisíce klasty ve vzorku půdy, který lze porovnat pouze graficky, například v diagramu Tri-Plot (Sneed and Folk),[44][45] nebo jako Stereonet v síti Wulff.[46]

Výstup pro tenzor orientace je ve třech ortogonálních (kolmých) osách prostoru. Jsou objednány tři vlastní vektory podle jejich vlastních čísel ;[47] pak je primární orientace / pokles klastu, je sekundární a je terciární, pokud jde o sílu. Orientace klastu je definována jako směr vlastního vektoru na a růžice kompasu z 360°. Ponor se měří jako vlastní hodnota, modul tenzoru: má hodnotu od 0 ° (bez poklesu) do 90 ° (svisle). Relativní hodnoty , , a jsou diktovány povahou látky sedimentu. Li , látka se říká, že je izotropní. Li , tkanina se říká, že je plochá. Li , tkanina se říká, že je lineární.[48]

Analýza hlavních komponent

The vlastní složení a symetrický pozitivní semidefinit (PSD) matice výnosy ortogonální základ vlastních vektorů, z nichž každý má nezáporné vlastní číslo. Ortogonální rozklad matice PSD se používá v vícerozměrná analýza, Kde vzorek kovarianční matice jsou PSD. Tento ortogonální rozklad se nazývá analýza hlavních komponent (PCA) ve statistikách. Studie PCA lineární vztahy mezi proměnnými. PCA se provádí na kovarianční matice nebo korelační matice (ve kterém je každá proměnná upravena tak, aby měla svou rozptyl vzorku rovná jedné). Pro kovarianční nebo korelační matici odpovídají vlastní vektory hlavní komponenty a vlastní čísla do rozptyl vysvětlen hlavními složkami. Analýza hlavních komponent korelační matice poskytuje ortogonální základ pro prostor pozorovaných dat: Na tomto základě odpovídají největší vlastní čísla hlavním složkám, které jsou spojeny s většinou kovariability mezi řadou pozorovaných dat.

Analýza hlavních komponent se používá jako prostředek snížení rozměrů ve studiu velkých datové sady, jako jsou ty, které se vyskytly v bioinformatika. v Q metodologie, vlastní čísla korelační matice určují úsudek Q-metodologa o praktický význam (který se liší od statistická významnost z testování hypotéz; srov. kritéria pro stanovení počtu faktorů ). Obecněji lze analýzu hlavních komponent použít jako metodu faktorová analýza v modelování strukturálních rovnic.

Vibrační analýza

Problémy s vlastními čísly se přirozeně vyskytují při vibrační analýze mechanických struktur s mnoha stupně svobody. Vlastní čísla jsou přirozené frekvence (nebo vlastní frekvence) vibrací a vlastní vektory jsou tvary těchto vibračních režimů. Zejména netlumené vibrace se řídí

nebo

to znamená, že zrychlení je úměrné poloze (tj. očekáváme být v čase sinusový).

v rozměry, se stává hmotnostní matice a A matice tuhosti. Přípustná řešení jsou pak lineární kombinací řešení zobecněný problém vlastních čísel

kde je vlastní číslo a je (imaginární) úhlová frekvence. Hlavní režimy vibrací se liší od hlavních režimů souladu, které jsou vlastními vektory sama. Dále tlumené vibrace, řízené

vede k tzv problém kvadratické vlastní hodnoty,

To lze snížit na obecný problém vlastních čísel o algebraická manipulace za cenu řešení většího systému.

Vlastnosti ortogonality vlastních vektorů umožňují oddělení diferenciálních rovnic, takže systém lze reprezentovat jako lineární součet vlastních vektorů. Problém vlastních čísel složitých struktur je často řešen pomocí analýza konečných prvků, ale úhledně zobecnit řešení problémů s vibracemi se skalární hodnotou.

Vlastní tvary

v zpracování obrazu, zpracované obrazy tváří lze vidět jako vektory, jejichž složkami jsou jasy každého pixel.[49] Rozměr tohoto vektorového prostoru je počet pixelů. Vlastní vektory kovarianční matice spojené s velkou sadou normalizovaných obrázků tváří vlastní plochy; toto je příklad analýza hlavních komponent. Jsou velmi užitečné pro vyjádření jakéhokoli obrazu tváře jako a lineární kombinace některých z nich. V Rozpoznávání obličeje pobočka biometrie Vlastní tvary poskytují způsob aplikace komprese dat čelit pro identifikace účely. Rovněž byl proveden výzkum týkající se systémů vlastního vidění určujících gesta rukou.

Podobně jako tento koncept, vlastní čísla představují obecný směr variability lidských výslovností určité výpovědi, například slova v jazyce. Na základě lineární kombinace takových vlastních čísel může být vytvořena nová hlasová výslovnost slova. Tyto koncepty byly shledány užitečnými v systémech automatického rozpoznávání řeči pro přizpůsobení reproduktorů.

Tenzor momentu setrvačnosti

v mechanika, vlastní vektory moment setrvačnosti tenzor definovat hlavní osy a tuhé tělo. The tenzor okamžiku setrvačnost je klíčová veličina potřebná k určení rotace tuhého tělesa kolem něj těžiště.

Tenzor stresu

v mechanika těles, stres tensor je symetrický a lze jej tedy rozložit na a úhlopříčka tenzor s vlastními hodnotami na úhlopříčce a vlastních vektorech jako základ. Protože je diagonální, v této orientaci nemá tenzor napětí žádnou stříhat komponenty; komponenty, které má, jsou hlavní komponenty.

Grafy

v teorie spektrálních grafů, vlastní číslo a graf je definována jako vlastní hodnota grafu matice sousedství , nebo (stále častěji) grafu Laplaciánská matice kvůli jeho diskrétní Laplaceův operátor, což je buď (někdy nazývaný kombinatorický laplacián) nebo (někdy nazývaný normalizovaný Laplacian), kde je diagonální matice s rovná se stupni vrcholu a v , diagonální vstup je . The první vlastní vektor grafu je definován jako vlastní vektor odpovídající th největší nebo th nejmenší vlastní číslo Laplacian. První hlavní vlastní graf je také označován pouze jako hlavní vlastní vlastní vektor.

Hlavní vlastní vektor se používá k měření ústřednost jeho vrcholů. Příkladem je Google je PageRank algoritmus. Hlavní vlastní vektor modifikovaného matice sousedství grafu World Wide Web dává stránce hodnocení jako jejích komponent. Tento vektor odpovídá stacionární distribuce z Markovův řetězec představovaná řádkově normalizovanou maticí sousedství; nejprve však musí být upravena matice sousedství, aby bylo zajištěno, že existuje stacionární distribuce. Druhý nejmenší vlastní vektor lze použít k rozdělení grafu do klastrů pomocí spektrální shlukování. Pro shlukování jsou k dispozici i další metody.

Základní reprodukční číslo

Základní reprodukční číslo () je základním číslem ve studiu šíření infekčních nemocí. Pokud je jedna infekční osoba zařazena do populace zcela vnímavých lidí, pak je průměrný počet lidí, které nakazí jedna typická infekční osoba. Generační čas infekce je čas, , od jedné osoby nakažené k další nakažené osobě. V heterogenní populaci matice příští generace definuje, kolik lidí v populaci se po čase nakazí prošel. je pak největší vlastní hodnota matice příští generace.[50][51]

Viz také

- Teorie antieigenvalue

- Vlastní operátor

- Vlastní letadlo

- Algoritmus vlastních čísel

- Úvod do vlastních stavů

- Jordan normální forma

- Seznam softwaru pro numerickou analýzu

- Nelineární vlastní problém

- Normální vlastní číslo

- Problém kvadratické vlastní hodnoty

- Singulární hodnota

- Spektrum matice

Poznámky

- ^ Poznámka:

- V roce 1751 Leonhard Euler dokázal, že každé těleso má hlavní osu otáčení: Leonhard Euler (představeno: říjen 1751; publikováno: 1760) „Du mouvement d'un corps solide quelconque lorsqu'il tourne autour d'un ax mobile“ (Při pohybu libovolného pevného těla, když se otáčí kolem pohyblivé osy), Histoire de l'Académie royale des sciences et des belles lettres de Berlin, str. 176–227. Na str. 212, Euler dokazuje, že jakékoli tělo obsahuje hlavní osu otáčení: „Théorem. 44. De quelque figure que soit le corps, on y peut toujours assigner un tel ax, qui passe par son center de gravité, autour duquel le corps peut tourner librement & d'un mouvement uniforme.“ (Věta 44. Ať už je tvar těla jakýkoli, vždy mu lze přiřadit takovou osu, která prochází jeho těžištěm, kolem kterého se může volně a rovnoměrně otáčet.)

- V roce 1755 Johann Andreas Segner dokázal, že každé tělo má tři hlavní osy rotace: Johann Andreas Segner, Vzorek theoriae turbinum [Esej o teorii vrcholů (tj. Rotujících těles)] (Halle („Halae“), (Německo): Gebauer, 1755). (https://books.google.com/books?id=29 p. xxviiii [29]), Segner odvozuje rovnici třetího stupně v t, což dokazuje, že těleso má tři hlavní osy otáčení. Poté uvádí (na stejné stránce): „Non autem repugnat tres esse eiusmodi positiones plani HM, quia in aequatione cubica radices tres esse possunt, et tres tangentis t valores.“ (Není však nekonzistentní [že existují] tři takové polohy roviny HM, protože v kubických rovnicích [tam] mohou být tři kořeny a tři hodnoty tečny t.)

- O příslušné pasáži Segnerovy práce krátce hovořil Arthur Cayley. Viz: A. Cayley (1862) „Zpráva o postupu řešení některých zvláštních problémů dynamiky“ Zpráva o třicátém druhém zasedání Britské asociace pro pokrok ve vědě; se konala v Cambridge v říjnu 1862, 32: 184–252; viz zejména str. 225–226.

- ^ Kline 1972, s. 807–808 Augustin Cauchy (1839) „Memoire sur l'intégration des équations linéaires“ (Memoár o integraci lineárních rovnic), Comptes rendus, 8: 827–830, 845–865, 889–907, 931–937. Od p. 827: „On sait d'ailleurs qu'en suivant la méthode de Lagrange, on obtient pour valeur générale de la variable prinicipale une fonction dans laquelle entrent avec la variable principale les racines d'une certaine équation que j'appellerai l 'équation caractéristique, le degré de cette équation étant précisément l'order de l'équation différentielle qu'il s'agit d'intégrer. " (Navíc je známo, že podle Lagrangeovy metody získáme pro obecnou hodnotu hlavní proměnné funkci, ve které se spolu s hlavní proměnnou objeví kořeny určité rovnice, kterou budu nazývat „charakteristická rovnice“. , přičemž stupeň této rovnice je přesně řádem diferenciální rovnice, která musí být integrována.)

- ^ Vidět:

- David Hilbert (1904) „Grundzüge einer allgemeinen Theorie der linearen Integralgleichungen. (Erste Mitteilung)“ (Základy obecné teorie lineárních integrálních rovnic. (První zpráva)), Nachrichten von der Gesellschaft der Wissenschaften zu Göttingen, Mathematisch-Physikalische Klasse (Zprávy filozofické společnosti v Göttingenu, matematicko-fyzikální část), s. 49–91. Od p. 51: „Insbesondere in dieser ersten Mitteilung gelange ich zu Formeln, die die Entwickelung einer willkürlichen Funktion nach gewissen ausgezeichneten Funktionen, die ich 'Eigenfunktionen' nenne, liefern:…“ (Zejména v této první zprávě se dostávám k vzorcům, které poskytují [řadový] vývoj libovolné funkce, pokud jde o některé charakteristické funkce, které nazývám vlastní funkce:…) Později na stejné stránce: „Dieser Erfolg ist wesentlich durch den Umstand bedingt, daß ich nicht, wie es bisher geschah, in erster Linie auf den Beweis für die Existenz der Eigenwerte ausgehe,…“ (Tento úspěch lze přičíst hlavně skutečnosti, že se nesnažím, jak se to stalo doposud, nejprve prokázat existenci vlastních čísel,…)

- Původ a vývoj pojmů vlastní hodnota, charakteristická hodnota atd. Viz: Nejstarší známá použití některých slov matematiky (E)

- ^ Důkaz tohoto lemmatu viz Roman 2008, Věta 8.2 na str. 186; Shilov 1977, str. 109; Hefferon 2001, str. 364; Beezer 2006, Věta EDELI na str. 469; a Lema pro lineární nezávislost vlastních vektorů

- ^ Tím, že dělá Gaussova eliminace přes formální mocenské řady zkrácen na podmínek je možné se dostat pryč operace, ale to nezabere kombinatorická exploze v úvahu.

Citace

- ^ „Úplný seznam symbolů algebry“. Matematický trezor. 25. března 2020. Citováno 19. srpna 2020.

- ^ Burden & Faires 1993, str. 401.

- ^ Herstein 1964, str. 228, 229.

- ^ A b Nering 1970, str. 38.

- ^ Weisstein, Eric W. „Vlastní hodnota“. mathworld.wolfram.com. Citováno 19. srpna 2020.

- ^ Betteridge 1965.

- ^ A b "Vlastní vektor a vlastní hodnota". www.mathsisfun.com. Citováno 19. srpna 2020.

- ^ Press et al. 2007, str. 536.

- ^ Wolfram.com: Vlastní vektor.

- ^ A b C d Nering 1970, str. 107.

- ^ Hawkins 1975, §2.

- ^ A b C d Hawkins 1975, §3.

- ^ Kline 1972, str. 673.

- ^ A b Kline 1972, str. 807–808.

- ^ Kline 1972, str. 715–716.

- ^ Kline 1972, str. 706–707.

- ^ Kline 1972, str. 1063, str.

- ^ Aldrich 2006.

- ^ Francis 1961, str. 265–271.

- ^ Kublanovskaya 1961, str. 637–657.

- ^ Golub & Van Loan 1996, §7.3.

- ^ Meyer 2000, §7.3.

- ^ Katedra matematiky na Cornell University (2016) Kurzy nižší úrovně pro prváky a druhé ročníky. Zpřístupněno 27. 3. 2016.

- ^ Matematika na University of Michigan (2016) Katalog matematických kurzů Archivováno 2015-11-01 na Wayback Machine. Zpřístupněno 27. 3. 2016.

- ^ Herstein 1964, str. 228 229.

- ^ Press et al. 2007, str. 38.

- ^ Fraleigh 1976, str. 358.

- ^ A b C Golub & Van Loan 1996, str. 316.

- ^ Anton 1987, str. 305 307.

- ^ A b Beauregard & Fraleigh 1973, str. 307.

- ^ Herstein 1964, str. 272.

- ^ Nering 1970, str. 115–116.

- ^ Herstein 1964, str. 290.

- ^ Nering 1970, str. 116.

- ^ Wolchover 2019.

- ^ Denton a kol. 2019.

- ^ Van Mieghem 2014.

- ^ Korn a Korn 2000, Oddíl 14.3.5a.

- ^ Friedberg, Insel & Spence 1989, str. 217.

- ^ Nering 1970, str. 107; Shilov 1977, str. 109 Lema pro vlastní prostor

- ^ Lipschutz & Lipson 2002, str. 111.

- ^ Axler, str. 77.

- ^ A b C d Trefethen & Bau 1997.

- ^ Graham & Midgley 2000, str. 1473–1477.

- ^ Sneed & Folk 1958, str. 114–150.

- ^ Knox-Robinson & Gardoll 1998, str. 243.

- ^ Software Stereo32

- ^ Benn & Evans 2004, str. 103–107.

- ^ Xirouhakis, Votsis & Delopoulus 2004.

- ^ Journal of Mathematical Biology 1990, str. 365–382.

- ^ Heesterbeek & Diekmann 2000.

Zdroje

- Akivis, Max A .; Goldberg, Vladislav V. (1969), Tenzorový počet, Rus, Science Publishers, Moskva

- Aldrich, John (2006), „Vlastní hodnota, vlastní funkce, vlastní vektor a související výrazy“, Miller, Jeff (ed.), Nejstarší známá použití některých slov matematiky

- Alexandrov, Pavel S. (1968), Poznámky k přednášce v analytické geometrii, Rus, Science Publishers, Moskva[ISBN chybí ]

- Anton, Howard (1987), Elementární lineární algebra (5. vydání), New York: Wiley, ISBN 0-471-84819-0

- Axler, Sheldon, Lineární algebra Hotovo správně (3. vyd.), Springer, str. 77, ISBN 978-3-319-30765-7

- Beauregard, Raymond A .; Fraleigh, John B. (1973), První kurz v lineární algebře: s volitelným úvodem do skupin, prstenů a polí, Boston: Houghton Mifflin Co., ISBN 0-395-14017-X

- Beezer, Robert A. (2006), První kurz lineární algebry, Online kniha zdarma pod licencí GNU, University of Puget Sound

- Benn, D .; Evans, D. (2004), Praktický průvodce studiem ledovcových sedimentů, London: Arnold, s. 103–107

- Betteridge, Harold T. (1965), Německý slovník New Cassell, New York: Funk & Wagnall, LCCN 58-7924

- Bowen, Ray M .; Wang, Chao-Cheng (1980), Lineární a multilineární algebra, Plenum Press, New York, ISBN 0-306-37508-7

- Burden, Richard L .; Faires, J. Douglas (1993), Numerická analýza (5. vydání), Boston: Prindle, Weber a Schmidt, ISBN 0-534-93219-3

- Carter, Tamara A .; Tapia, Richard A .; Papaconstantinou, Anne, Linear Algebra: An Introduction to Linear Algebra for Pre-Calculus Students, Rice University, online vydání, vyvoláno 19. února 2008

- Cohen-Tannoudji, Claude (1977), "Kapitola II. Matematické nástroje kvantové mechaniky", Kvantová mechanikaJohn Wiley & Sons, ISBN 0-471-16432-1

- Curtis, Charles W. (1999), Lineární algebra: úvodní přístup (4. vyd.), Springer, ISBN 0-387-90992-3

- Demmel, James W. (1997), Aplikovaná numerická lineární algebra, SIAM, ISBN 0-89871-389-7

- Denton, Peter B .; Parke, Stephen J .; Tao, Terence; Zhang, Xining (10. srpna 2019). "Vlastní vektory z vlastních čísel: průzkum základní identity v lineární algebře". arXiv:1908.03795 [matematika. RA ].

- Diekmann O, Heesterbeek JA, Metz JA (1990), „O definici a výpočtu základního reprodukčního poměru R0 v modelech pro infekční nemoci v heterogenních populacích“, Journal of Mathematical Biology, 28 (4): 365–382, doi:10.1007 / BF00178324, hdl:1874/8051, PMID 2117040, S2CID 22275430

- Fraleigh, John B. (1976), První kurz v abstraktní algebře (2. vyd.), Čtení: Addison-Wesley, ISBN 0-201-01984-1

- Fraleigh, John B .; Beauregard, Raymond A. (1995), Lineární algebra (3. vyd.), Addison-Wesley Publishing Company, ISBN 0-201-83999-7

- Francis, J. G. F. (1961), „The QR Transformation, I (part 1)“, Počítačový deník, 4 (3): 265–271, doi:10.1093 / comjnl / 4.3.265a Francis, J. G. F. (1962), „The QR Transformation, II (part 2)“, Počítačový deník, 4 (4): 332–345, doi:10.1093 / comjnl / 4.4.332

- Francis, J. G. F. (1962), „The QR Transformation, II (part 2)“, Počítačový deník, 4 (4): 332–345, doi:10.1093 / comjnl / 4.4.332

- Friedberg, Stephen H .; Insel, Arnold J .; Spence, Lawrence E. (1989), Lineární algebra (2. vyd.), Englewood Cliffs, NJ: Prentice Hall, ISBN 0-13-537102-3

- Gelfand, I. M. (1971), Poznámky k přednášce v lineární algebře, Rus, Science Publishers, Moskva

- Gohberg, Izrael; Lancaster, Peter; Rodman, Leiba (2005), Neurčitá lineární algebra a aplikace, Basilej, Boston, Berlín: Birkhäuser Verlag, ISBN 3-7643-7349-0

- Golub, Gene F .; van der Vorst, Henk A. (2000), „Výpočet vlastních čísel ve 20. století“ (PDF), Journal of Computational and Applied Mathematics, 123 (1–2): 35–65, Bibcode:2000JCoAM.123 ... 35G, doi:10.1016 / S0377-0427 (00) 00413-1

- Golub, Gene H.; Van Loan, Charles F. (1996), Maticové výpočty (3. vyd.), Baltimore, MD: Johns Hopkins University Press, ISBN 978-0-8018-5414-9

- Graham, D .; Midgley, N. (2000), „Grafické znázornění tvaru částic pomocí trojúhelníkových diagramů: metoda tabulky Excel“, Procesy a formy zemského povrchu, 25 (13): 1473–1477, Bibcode:2000ESPL ... 25.1473G, doi:10.1002 / 1096-9837 (200012) 25:13 <1473 :: AID-ESP158> 3.0.CO; 2-C, S2CID 128825838

- Greub, Werner H. (1975), Lineární algebra (4. vydání), New York: Springer-Verlag, ISBN 0-387-90110-8

- Halmos, Paul R. (1987), Konečně-dimenzionální vektorové prostory (8. vydání), New York: Springer-Verlag, ISBN 0-387-90093-4

- Hawkins, T. (1975), „Cauchy a spektrální teorie matic“, Historia Mathematica, 2: 1–29, doi:10.1016/0315-0860(75)90032-4

- Heesterbeek, J. A. P .; Diekmann, Odo (2000), Matematická epidemiologie infekčních nemocí, Wileyova řada v matematické a výpočetní biologii, West Sussex, Anglie: John Wiley & Sons

- Hefferon, Jim (2001), Lineární algebra, Colchester, VT: Online kniha, St Michael's College

- Herstein, I.N. (1964), Témata v algebřeWaltham: Blaisdell Publishing Company, ISBN 978-1114541016

- Horn, Roger A .; Johnson, Charles F. (1985), Maticová analýza, Cambridge University Press, ISBN 0-521-30586-1

- Kline, Morris (1972), Matematické myšlení od starověku po moderní dobu, Oxford University Press, ISBN 0-19-501496-0

- Knox-Robinson, C .; Gardoll, Stephen J. (1998), „GIS-stereoplot: interaktivní stereonetový modul vykreslování pro geografický informační systém ArcView 3.0“, Počítače a geovědy, 24 (3): 243, Bibcode:1998CG ..... 24..243K, doi:10.1016 / S0098-3004 (97) 00122-2

- Korn, Granino A .; Korn, Theresa M. (2000), „Mathematical Handbook for Scientists and Engineers: Definitions, Theorems, and Formulas for Reference and Review“, New York: McGraw-Hill (2. přepracované vydání), Bibcode:1968mhse.book ..... K., ISBN 0-486-41147-8

- Kublanovskaya, Vera N. (1961), „O některých algoritmech pro řešení celého problému vlastních čísel“, SSSR výpočetní matematika a matematická fyzika, 3: 637–657. Publikováno také v: „О некоторых алгорифмах для решения полной проблемы собственных значений“ [O určitých algoritmech pro řešení celého problému s vlastní hodnotou], Журнал вычислительной математики a математической физики (Journal of Computational Mathematics and Mathematical Physics) (v Rusku), 1 (4): 555–570, 1961

- Kuttler, Kenneth (2007), Úvod do lineární algebry (PDF), Univerzita Brighama Younga

- Lancaster, P. (1973), Maticová teorie, Russian, Moscow: Science Publishers

- Larson, Ron; Edwards, Bruce H. (2003), Elementární lineární algebra (5. vydání), Houghton Mifflin Company, ISBN 0-618-33567-6

- Lipschutz, Seymour (1991), Schaumův obrys teorie a problémy lineární algebry, Schaumova osnova (2. vyd.), New York: McGraw-Hill Companies, ISBN 0-07-038007-4

- Lipschutz, Seymour; Lipson, Marc (12. srpna 2002). Schaumův snadný obrys lineární algebry. McGraw Hill Professional. p. 111. ISBN 978-007139880-0.

- Meyer, Carl D. (2000), Maticová analýza a aplikovaná lineární algebra, Philadelphia: Společnost pro průmyslovou a aplikovanou matematiku (SIAM), ISBN 978-0-89871-454-8

- Nering, Evar D. (1970), Lineární algebra a maticová teorie (2. vyd.), New York: Wiley, LCCN 76091646

- Press, William H .; Teukolsky, Saul A.; Vetterling, William T .; Flannery, Brian P. (2007), Numerické recepty: Umění vědecké práce na počítači (3. vyd.), ISBN 978-0521880688

- Roman, Steven (2008), Pokročilá lineární algebra (3. vyd.), New York: Springer Science + Business Media, ISBN 978-0-387-72828-5

- Sharipov, Ruslan A. (1996), Kurz lineární algebry a vícerozměrné geometrie: učebnice, arXiv:matematika / 0405323, Bibcode:2004math ...... 5323S, ISBN 5-7477-0099-5

- Shilov, Georgi E. (1977), Lineární algebraPřeložil a upravil Richard A. Silverman, New York: Dover Publications, ISBN 0-486-63518-X

- Shores, Thomas S. (2007), Aplikovaná lineární algebra a maticová analýzaSpringer Science + Business Media, ISBN 978-0-387-33194-2

- Sneed, E. D .; Folk, R. L. (1958), „Oblázky na dolní řece Colorado v Texasu, studie morfogeneze částic“, Geologický časopis, 66 (2): 114–150, Bibcode:1958JG ..... 66..114S, doi:10.1086/626490, S2CID 129658242

- Strang, Gilbert (1993), Úvod do lineární algebryWellesley, MA: Wellesley-Cambridge Press, ISBN 0-9614088-5-5

- Strang, Gilbert (2006), Lineární algebra a její aplikace, Belmont, CA: Thomson, Brooks / Cole, ISBN 0-03-010567-6

- Trefethen, Lloyd N .; Bau, David (1997), Numerická lineární algebra, SIAM

- Van Mieghem, Piet (18. ledna 2014). "Graf vlastních vektorů, základní váhy a metriky centrálnosti pro uzly v sítích". arXiv:1401.4580 [matematika.SP ].

- Weisstein, Eric W. "Vlastní vektor". mathworld.wolfram.com. Citováno 4. srpna 2019.

- Wolchover, Natalie (13. listopadu 2019). „Neutrina vedou k neočekávanému objevu v základní matematice“. Časopis Quanta. Citováno 27. listopadu 2019.

- Xirouhakis, A .; Votsis, G .; Delopoulus, A. (2004), Odhad 3D pohybu a struktury lidských tváří (PDF), Národní technická univerzita v Aténách

- (v Rusku)Pigolkina, T. S .; Shulman, V. S. (1977). "Vlastní hodnota". Ve Vinogradově, I. M. (ed.). Matematická encyklopedie. 5. Moskva: Sovětská encyklopedie.

Další čtení

- „Průvodce pro začátečníky po vlastních vektorech“. Deeplearning4j. 2015. Archivovány od originál dne 21. července 2018. Citováno 18. srpna 2015.

- Hill, Roger (2009). „λ - vlastní čísla“. Šedesát symbolů. Brady Haran pro University of Nottingham.

externí odkazy

Tento článek je Použití externí odkazy nemusí dodržovat zásady nebo pokyny Wikipedie. (Prosince 2019) (Zjistěte, jak a kdy odstranit tuto zprávu šablony) |

- Co jsou vlastní hodnoty? - netechnický úvod z knihy „Zeptejte se odborníků“ na webu PhysLink.com

- Vlastní hodnoty a vlastní vektory Numerické příklady - Výukový program a interaktivní program od společnosti Revoledu.

- Úvod do vlastních vektorů a vlastních hodnot - přednáška z Khan Academy

- Vlastní vektory a vlastní hodnoty | Podstata lineární algebry, kapitola 10 - Vizuální vysvětlení s 3Modrá1Hnědá

- Maticová vlastní kalkulačka ze Symbolabu (Kliknutím na pravé spodní tlačítko mřížky 2x12 vyberte velikost matice. Vyberte velikost (pro čtvercovou matici), poté vyplňte položky číselně a klikněte na tlačítko Přejít. Může přijímat i komplexní čísla.)

Teorie

- „Vlastní hodnota“, Encyclopedia of Mathematics, Stiskněte EMS, 2001 [1994]

- "Vlastní vektor", Encyclopedia of Mathematics, Stiskněte EMS, 2001 [1994]

- "Vlastní číslo (matice)". PlanetMath.

- Vlastní vektor - Wolfram MathWorld

- Vlastní applet pro vektorové zkoumání vlastního vektoru

- Stejné vlastní vektorové vyšetření jako výše v ukázce Flash se zvukem

- Výpočet vlastních čísel

- Numerické řešení úloh vlastních čísel Upravil Zhaojun Bai, James Demmel Jack Dongarra, Axel Ruhe a Henk van der Vorst

- Vlastní čísla a vlastní vektory na fórech Ask Dr. Math: [1], [2]

![{ displaystyle { bigl [} { begin {smallmatrix} 2 & 1 1 & 2 end {smallmatrix}} { bigr]}}](https://wikimedia.org/api/rest_v1/media/math/render/svg/dcacd8bee0f5c4d9f5e8e3fc2c4932447e0e2aec)

![{ displaystyle { begin {zarovnané} | A- lambda I | & = left | { begin {bmatrix} 2 & 1 1 & 2 end {bmatrix}} - lambda { begin {bmatrix} 1 & 0 0 & 1 end {bmatrix}} right | = { begin {vmatrix} 2- lambda & 1 1 & 2- lambda end {vmatrix}}, [6pt] & = 3-4 lambda + lambda ^ {2}. End {zarovnáno}}}](https://wikimedia.org/api/rest_v1/media/math/render/svg/616c8bf6fe953c6bfbda5132efcdf799d4f13ced)

![{ displaystyle { begin {aligned} | A- lambda I | & = left | { begin {bmatrix} 2 & 0 & 0 0 & 3 & 4 0 & 4 & 9 end {bmatrix}} - lambda { begin {bmatrix} 1 a 0 a 0 0 & 1 & 0 0 & 0 & 1 end {bmatrix}} right | = { begin {vmatrix} 2- lambda & 0 & 0 0 & 3- lambda & 4 0 & 4 & 9- lambda end {vmatrix}}, [ 6pt] & = (2- lambda) { bigl [} (3- lambda) (9- lambda) -16 { bigr]} = - lambda ^ {3} +14 lambda ^ {2} -35 lambda +22. End {zarovnáno}}}](https://wikimedia.org/api/rest_v1/media/math/render/svg/30165fb86a7e23644d2e3373a1c2c68af4756523)